米中北京首脳会談でAIガードレールを協議——「非国家主体の悪用防止」という共通言語が生まれた意味

※本記事は2026/05/15時点での情報を基にしており、閲覧時点では内容や状況が変わっている可能性があります。

5月14〜15日、米大統領として約9年ぶりに中国を訪問したTrump大統領とXi Jinping国家主席が北京の人民大会堂で首脳会談を行った。貿易・関税・台湾・イランに加え、人工知能(AI)も議題に上がった今回の会談は、世界が固唾をのんで見守る歴史的な2日間となった。

米中代表団は北京首脳会談においてAIガードレールを協議し、非国家主体による最も強力なAIモデルの悪用を防ぐためのベストプラクティスのプロトコルを策定することになると、Reutersが報じた。

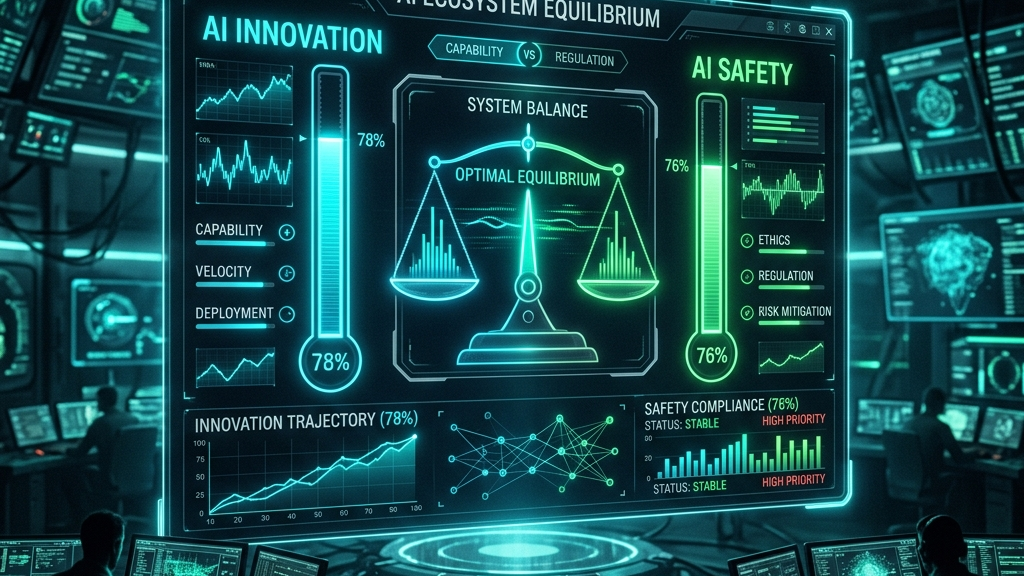

財務長官Scott BessentはCNBCのインタビューで、米国がAIにおいて中国に対するリードを維持することが「最重要だ」と述べ、それこそが北京がガードレール協議に関心を持つ理由だと付け加えた。「私たちがやりたくないのはイノベーションを阻害することだ。だから私たちの責任は、最大のイノベーションと最高水準の安全を両立できる最高性能の計算式を見つけることだ」とBessentは述べた。

この発言の論理構造は明確だ——米国はAIで中国をリードしているからこそ、ルールを設定する立場にある。そのリードを守りながら、最悪の事態(AIの悪用による制御不能な危機)だけは防ぐ。これがTrump政権のAIガバナンスに対する基本姿勢だ。

なぜ「非国家主体」というフレーミングなのか

「米中対立の管理」ではなく「共通の脅威への対処」

今回の協議で最も注目すべきは「非国家主体(non-state bad actors)」というフレーミングだ。これは国家間のAI競争そのものを止める話ではない。犯罪組織・テロ組織・高度なサイバー攻撃グループなど、国家の管理外にある主体がフロンティアAIモデルを悪用することを防ぐという、米中が共有できる最小公約数の問題設定だ。

この設計は外交的に巧みだ。「中国のAIを制限しよう」という議題では中国は着席しない。しかし「テロリストやサイバー犯罪者が超強力なAIを手に入れた場合、それは米国にも中国にも等しく脅威だ」という枠組みであれば、少なくとも対話のテーブルに着く動機が生まれる。

特に最先端AIが悪用されうる具体的なリスクは、本シリーズでも既報のように実像を帯びてきている。サイバーセキュリティ分野では、Anthropicが開発したMythosが数千件以上の高深刻度ゼロデイ脆弱性を発見・実証できるとされ、NSAが独自に能力検証を進めた(5月5日付け記事参照)。

金融インフラへの攻撃自動化、偽情報・世論操作の高度化、生物・化学兵器関連情報への悪用。これらは将来のリスクではなく、「今年中に現実化しうるリスク」として政府が認識し始めている。

「AI版軍備管理」という歴史的な文脈

今回の協議は、AIをめぐる国際規範形成の流れの中に位置づけることができる。2024年後半、Biden政権下での米中首脳会談では核兵器の使用判断をAIではなく人間が管理すべきとの認識で一致した。これは軍事AIリスクに関する限定的な合意だった。

今回はその範囲が広がっている。核兵器に限らず、最先端AIモデル全般・非国家主体による悪用・サイバーリスク・自律システムまで含む可能性がある。

冷戦期における核兵器の軍備管理条約(SALT・START)が「完全な軍縮」ではなく「制御不能なエスカレーションの防止」を目的としたように、今回のAIガードレール協議も「AI競争の終結」ではなく「AI起因の制御不能な危機の防止」というより現実的な目標を持っている。

首脳会談の全体像——AIは「最大の議題」ではなく「構造的な議題」

首脳会談の主な論点

Trump-Xi首脳会談の初日、米中は「建設的な中米戦略的安定関係」の構築に向けて今後3年以上の指針となる枠組みで合意したと、北京の公式英語声明が伝えた。

会談の核心的な論点は関税、台湾、AI、そしてイランだった。経済分野では中国による米国農産品・工業製品の購入拡大、貿易再均衡の議論が続けられた。

今回の米国代表団の特徴は、その規模と顔ぶれだ。TeslaのElon Musk、AppleのTim Cook、BlackRockのLarry Fink、BoeingのKelly Ortbergをはじめとする計17名のCEOがTrumpの訪中に同行した。

NvidiaのJensen Huangも参加しており、AI・半導体をめぐる米中の技術外交が「国家交渉」と「民間ビジネス交渉」を同時並行で進める構造になっていることが浮き彫りになった。

会談直後に動いたNvidiaのH200チップ販売

今回の首脳会談で最も具体的なAI関連の動きとして注目されるのが、TrumpとXiが会談した直後、Reutersが「ワシントンがNvidiaのH200 AIチップを中国の主要テック企業数社に販売許可を出した」と、事情に詳しい3人の関係者の話として報じたことだ。

「NvidiaはまだAI関連機器を中国市場に販売できるよう、米国政府に働きかけていると我々は考えている」とMorningstarのシニアアナリストBrian Colelloは述べ、「Nvidiaは中国のAIスタックの一部となれるような形で中国への販売を可能にする解決策を交渉したいと考えているのではないか」と分析した。

H200はNvidiaの高性能AIチップの一つで、より高性能なH100やBlackwellアーキテクチャ製品よりも輸出規制の対象外となる可能性が高い製品だ。今回の件が確認されれば、AIガードレール協議という「共同規制」の文脈と、チップ輸出許可という「商業的開放」の文脈が同時進行しているという複雑な構造を示す。

なぜ合意は難しいのか——米中不信の構造的要因

CSISが分析する「相対的に控えめな進展」

戦略国際問題研究所(CSIS)は、今回のTrump訪中は「世界で最も重要な二国間関係の安定性と予測可能性に向けた、比較的控えめな一歩を意味するだろう」と分析している。中国はTrumpが多くの重要問題(制裁・技術規制・重要鉱物・イラン)で強硬な立場を取ろうとすれば十分に対抗できると感じており、それが中国の自信の根拠となっている。

AIガードレール協議においても、この構造的な不信が障壁となる。米国は中国への先端半導体とAI技術のアクセスを制限している。中国側は米国主導のAIルール形成が「競争上の優位を固定化しようとする動き」に見える。双方が「ガードレールで守るべき共通利益」を認識しながらも、「相手が誠実にルールを守るかどうか」への疑念が拭えない状況だ。

「公式声明への非明示」という現実

今回のAIガードレール協議が正式な合意文書として公式声明に明記されなかったという点は、この協議の「現在地」を正確に示している。CSISが「コンプライアンスチェックポイントであり、ブレークスルーではない」と評する通り、今回の首脳会談は劇的な転換点ではなく、対話チャネルの維持と漸進的な信頼醸成という地道なプロセスの一里塚として位置づけるのが適切だ。

米中のAI協議が可能なのは「米国がリードしているから」という論理——つまりBessentが示した「リードしているからこそルール設定の主体になれる」という構造は、AI競争が激化するほどこの対話の継続が難しくなるという逆説も内包している。

「AIガバナンスの地政学化」が示す産業構造の変化

AIは「産業競争」から「安全保障管理対象」へ

今回の協議が持つ最も深い意味は、AIが純粋な産業競争の対象から「国家安全保障上の管理対象」へと移行したことの公式化だ。

半導体の輸出規制(2022年〜)が「AIを巡る地政学の序章」だったとすれば、フロンティアAIモデルそのもののアクセス管理・悪用防止のプロトコルを米中が直接協議するという今回の動きは「本章」の開始だといえる。

本シリーズで取り上げてきた一連の出来事——NIST-CAISIが Google・Microsoft・xAIとフロンティアAIの事前評価契約を締結し(5月5日付け記事参照)、Anthropic Mythosへの懸念がTrump政権のAI監督強化を引き起こした流れ——は、今回の米中協議と同じ潮流の上にある。

「AIは最強の国が最も自由に使える」という世界から、「AIは最強のプレーヤーも含めて、最低限のルールの下に置かれる」世界への移行が、ゆっくりと、しかし確実に始まっている。

CFRが示す「最大限の圧力+対話」という方程式

外交問題評議会(CFR)のシニアフェローHeidi Crebo-RedikerはAI安全保障についてこう論じている。「代替案は、中国に追いつくためのツールを与えながら誠実に行動することを望む——あるいは、北京に真の世界的責任感を植え付けるような大惨事を待つ——かのどちらかだ。

どちらも責任ある選択肢ではない。最大限の圧力と対話は、米国のAIリーダーシップを維持するだけでなく、長期的なAI安全を実現する最善の方法でもある。」

この分析は、今回の米中AI協議の本質をよく捉えている。「協調か競争か」という二項対立を超え、「競争しながら最悪のシナリオだけは協調して防ぐ」という複雑なゲームをどう運営するかが、今後数年間の米中AI関係の中心的な問いとなる。

日本企業・BtoBマーケターが今から考えるべきこと

「AIコンプライアンス」が調達基準に加わる時代

今回の米中AI協議が示す中長期的な含意は、フロンティアAIモデルの利用がより厳格な管理・アクセス制御・悪用防止策を求められる時代へと移行しつつあるという点だ。

本シリーズで報じたCAISI合意(Google・Microsoft・xAIの事前評価契約)や、GPT-5.5-Cyber Preview(審査済みチームのみへの限定公開)は、この方向性を先取りした事例だ。

日本企業に直接的な規制が降りかかるのは今すぐではない。しかし、フロンティアAIを業務に組み込む企業が将来的に直面しうる問いは今から想定できる——「このAIモデルはどの国の誰が開発・運用しているか」「どのデータへのアクセスを持ち、どのような権限で動作するか」「悪用防止のためにどのような評価・審査を経ているか」。

NTTドコモビジネスが提起した問いとのつながり

前日(5月12日付け記事)で取り上げたNTTドコモビジネスの「AIエージェント属性情報レジストリ(仮称)」——AIエージェントの開発者・運用主体・所在国・実行権限を第三者が検証可能な形で管理する基盤——は、今回の米中AI協議が示す「AIの発行・運用主体と権限の正当性を担保する必要性」という大きな流れと方向性を一にしている。

国際的なAIガードレールの議論が進むほど、「どのAIを誰がどのような権限で使っているか」を説明可能にする基盤の価値は高まる。

「AI版Wassenaar協定」の可能性

中長期的に注視すべきシナリオの一つは、今回の米中ガードレール協議が、AI分野における多国間輸出管理体制——冷戦後の兵器・デュアルユース技術の輸出規制を定めたWassenaar Arrangementに相当するようなAI版の国際枠組み——の萌芽となる可能性だ。

現時点ではその可能性は低いとアナリストも評価しているが、ひとたびAI起因の重大な国際事故が発生すれば、この議論は一気に加速しうる。

BtoBのSaaS企業や製造・金融・医療のエンタープライズ企業にとって、「将来のAI規制の出発点となりうる対話が今週始まった」という認識を持ち、自社のAI利用ポリシー・ベンダー管理・データガバナンスの体制を今から整備しておくことが、長期的なリスク管理の基礎体力となる。

「AIガバナンスの時代」の幕開けを告げた一週間

今週(2026年5月8日〜15日)を俯瞰すると、一本の太い流れが見える。

NIST-CAISIによるフロンティアAI事前評価の制度化(5月5日)、GPT-5.5 Instantのデフォルト化とGPT-5.5-Cyber Preview(審査済みチームのみへの限定公開、5月5〜8日)、MetaのIncognito Chat(TEEによるプライバシー技術の消費者向け展開、5月13日)、NTTドコモビジネスのAIエージェント信頼基盤プロトタイプ(5月12日)——そして今日の米中AI ガードレール協議。

これらは個別のニュースとして読むこともできるが、一つの大きなテーマの異なる側面として読む視点がより本質に近い。

AIは「誰がより賢いモデルを作れるか」という能力競争の段階を超え、「誰が責任を持ってAIを管理・展開できるか」というガバナンスの問いに答える段階に入った。能力と信頼、競争と協調、イノベーションと安全——この多次元の方程式を解く努力が、国家・企業・技術者の全レイヤーで同時進行している。

※出典:US, China are discussing AI guardrails to safeguard most powerful models(Reuters / Yahoo Finance) / Trump and Xi open Beijing summit: Taiwan, AI, tariffs on agenda(CNBC) / US, China are discussing AI guardrails(Reuters / Daily Signal) / Trump and Xi open Beijing summit(CNBC) / Trump-Xi Summit tech flashpoints(CNBC) / Trump-Xi Summit: Managing the World’s Most Important Relationship(CSIS) / At the Trump-Xi Summit, China Will Have the Upper Hand(CFR) / U.S.-China AI Guardrails context(AI Dispatch, Hipther)