Microsoft 365 CopilotがGPT×Claude連携へ——マルチモデル化で「幻覚」を減らす新設計

※本記事は2026/04/08時点での情報を基にしており、閲覧時点では内容や状況が変わっている可能性があります。

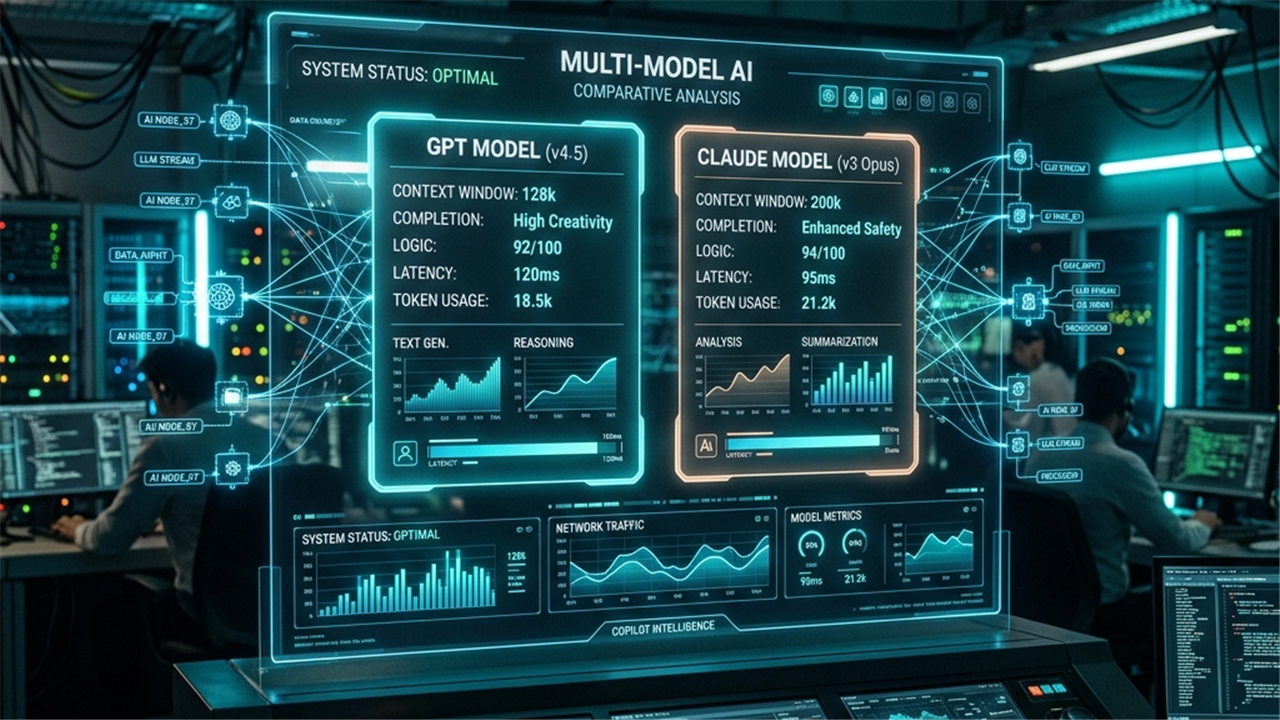

2026年3月下旬から4月にかけて、MicrosoftはMicrosoft 365 Copilotの設計を大きく刷新した。単一のAIモデルに依存するアーキテクチャから脱却し、OpenAIのGPT系モデルとAnthropicのClaudeを組み合わせたマルチモデルインテリジェンスへの移行だ。主要な目的はハルシネーション(幻覚)の低減と出力精度の向上にある。

企業向けAIツールとして広く普及したCopilotが、なぜこのタイミングでマルチモデル化に踏み切ったのか。そして、その設計思想は実際の業務にどのような影響をもたらすのか。今回の発表の核心を整理する。

単一モデルでは限界があった——なぜ今、マルチモデルなのか

AIが回答を生成する際の最大の課題の一つが、自信を持って誤った情報を出力するハルシネーションだ。生成と評価を同じモデルが担う構造では、自分の出力の誤りを自分で検出するのは難しい。人間でも同様で、自分が書いた文章の誤りは第三者に指摘されて初めて気づくことが多い。

Microsoftがとった解決策は明快だ。GPTとClaudeをそれぞれ異なる役割に割り当て、一方が生成し、もう一方が評価するという分業構造を取り入れた。単一モデルに優秀さを求めるのではなく、複数モデルの組み合わせによって出力品質を担保する設計思想である。

企業のAI活用が「試験的な導入」から「基幹業務への組み込み」へ移行しつつある現在、ハルシネーションによる誤情報は単なる品質問題にとどまらず、意思決定への悪影響や法的リスクにも直結する。マルチモデル化は、エンタープライズ向けとしての信頼性を確保するための実際的な回答といえる。

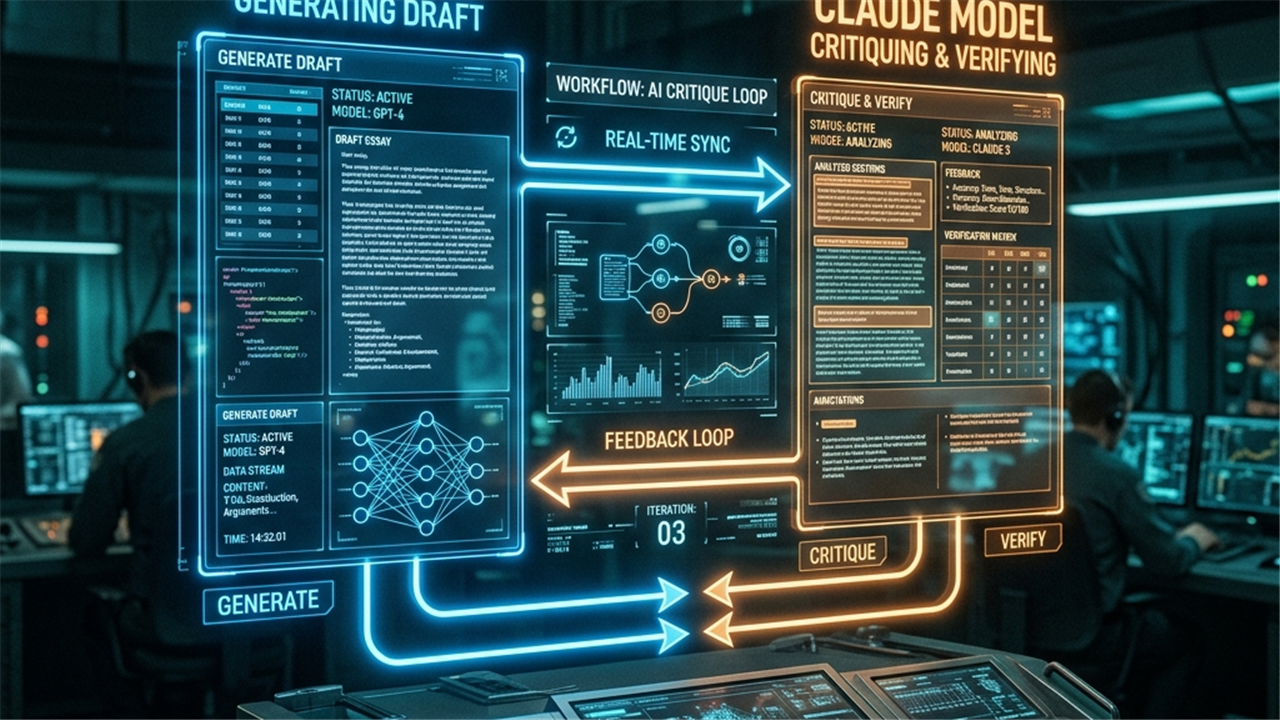

Critique機能——Claudeが「第二の目」として検証する仕組み

Researcherエージェント内に新設されたCritique(クリティーク)機能は、生成と評価を異なるモデルに分担させる設計だ。

プロセスはシンプルだ。GPTがまず回答のドラフトを作成し、続いてClaudeがその内容を評価・検証する。Claudeのチェック対象は正確性、完全性、引用の信頼性、事実誤認の有無の4点だ。ユーザーが出力を目にする前に、別モデルによる二重チェックが完了している状態になる。

Microsoftが公開したDRACOベンチマークでのスコア改善は13.8ポイントとの報告がある。数値そのものの解釈には注意が必要だが、評価分離による一定の品質向上効果については、設計の合理性からも理解できる。

エンタープライズ用途では引用の正確性や事実確認が特に重視される。法務・コンプライアンス資料の作成や、投資判断に使うリサーチレポートなど、誤情報が重大な影響をもたらす業務領域においては、Critique機能の実用的な価値は小さくない。

エンタープライズ活用における示唆

Critique機能が有効に機能するのは、精度より速度を優先すべき場面ではなく、正確性が最優先される業務シナリオだ。稟議書の下書きや市場調査レポートの要約、RFP(提案依頼書)の分析といった、出力に対して責任が発生する場面での活用を検討する価値がある。

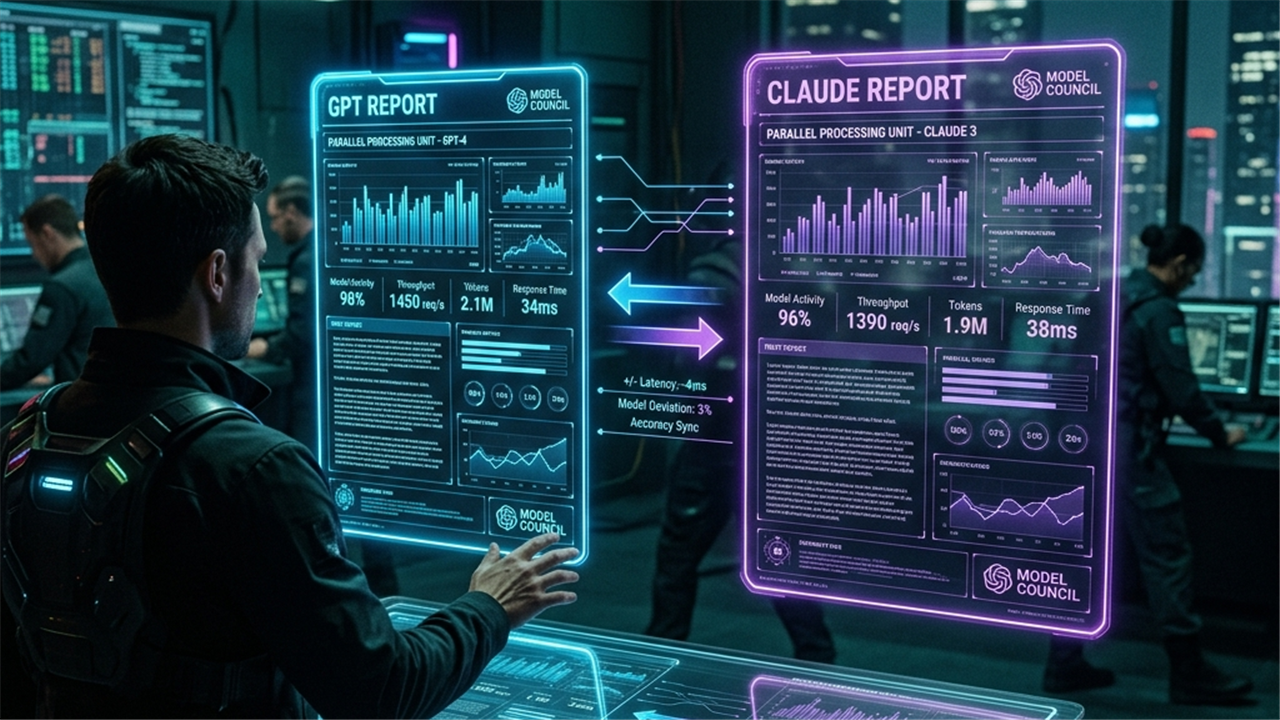

Model Council——複数モデルが独立回答、ユーザーが比較して選ぶ

Model Council(モデル評議会)は、Critique機能とは異なるアプローチで複数モデルを活用する機能だ。

同一のプロンプトに対してGPTとClaudeが並行稼働し、それぞれ独立したレポートを作成する。事実、引用、分析視点の差異が即座に比較表示されるため、ユーザーは2つの視点を見比べながら最終的な判断を自分で下せる。Critiqueがシステム側で自動検証を行う仕組みであるのに対し、Model Councilはユーザーの判断を支援する設計だ。

特に有効なのは、複雑なリサーチや戦略文書の作成場面だ。1つのモデルが強調する論点と、別のモデルが拾い上げる別の視点を並列で確認できることは、経営判断や投資判断を伴う業務において実用的な価値を持つ。

なぜ複数モデルの差異が価値を生むのか

GPTとClaudeはトレーニングデータ、アーキテクチャ、最適化の方針が異なる。同じ問いに対して異なる結論を出すことがあるのは、モデルの「欠陥」ではなく、異なる知識基盤からの異なる解釈として理解すべきだ。Model Councilはこの差異を「ノイズ」として除去するのではなく、意思決定の幅を広げるリソースとして活用する設計思想に基づいている。

Copilot Cowork——多段階タスクを自律実行するエージェント機能

3つ目の柱は、Anthropicの「Claude Cowork」技術をMicrosoft 365に統合した自律型エージェント、Copilot Coworkだ。

Coworkはユーザーの意図を読み取り、多段階タスクを自律的に実行する。たとえば資料収集から始まり、スプレッドシートの作成、報告書の生成、Teamsへの通知送信という一連の業務フローを、人の介在なしに完結させることができる。

Microsoft 365内の全データ・アプリと連携しながら、企業のガバナンス要件を維持して長時間稼働する点がエンタープライズ向けとしての特徴だ。現在はFrontierプログラム(早期採用プログラム)として展開されており、Wave 3アップデートの一部として本格普及が進んでいる。Capital Groupなど大手企業での実運用事例もすでに公開されている。

「何をしているか」をユーザーが把握できるか

自律型エージェントの課題の一つは、何を行っているかの透明性だ。Copilot Coworkについては、エンタープライズガバナンスへの対応を重視している点がMicrosoftの発表でも強調されているが、実際の運用における監査ログの取り扱いや、誤作動時の責任の所在については、各企業が導入前に確認すべき論点となる。

エージェントが多段階タスクを自動実行する利便性は高い一方、どの判断をAIに委ね、どこで人間が介在するかの設計は、業務の性質に応じて慎重に検討する必要がある。

Copilotは「最適モデルを自動選択するプラットフォーム」へ

今回の一連のアップデートが示す方向性は明確だ。CopilotはOpenAIのモデルに縛られたツールではなく、タスクの性質に応じて最適なモデルを自動選択する中立的なプラットフォームとして再定義されつつある。

企業にとっての意味は大きい。自社のセキュリティポリシーやコンプライアンス要件を維持しながら、OpenAIとAnthropicという異なる技術基盤のモデルを使い分けられる環境が整う。今後はGoogleのGeminiなど他モデルとの連携拡大が予想され、マルチモデル化はエンタープライズAIの標準的な設計思想になっていく可能性が高い。

単一モデル依存から脱却したCopilotの設計変更は、精度と信頼性の向上を求めてきた企業ユーザーにとって、一つの実際的な回答と言える。ただし、マルチモデル連携の恩恵を最大化するには、各機能がどのシナリオで有効かを理解したうえで活用設計を行うことが前提となる。

マルチモデル時代のエンタープライズAI戦略に何が求められるか

CopilotのマルチモデルアーキテクチャはAIの精度問題に対する技術的な解として機能しうるが、それだけで組織の課題が解決するわけではない。活用設計、ガバナンス整備、業務プロセスの再設計といった人間側の対応が、技術の価値を左右する。

エンタープライズAI活用の中核課題が「どのモデルを使うか」から「どのようにモデルを組み合わせ、どのように人間の判断と役割分担を設計するか」へ移行しつつある現在、Microsoftのマルチモデル戦略はその転換を象徴する動きとして注目に値する。