米ホワイトハウスが連邦統一AIフレームワークを公表——州法乱立を防ぐ動きが企業のAI導入戦略に与える影響

※本記事は2026/03/21時点での情報を基にしており、閲覧時点では内容や状況が変わっている可能性があります。

米国AI政策の地図が塗り替わった?

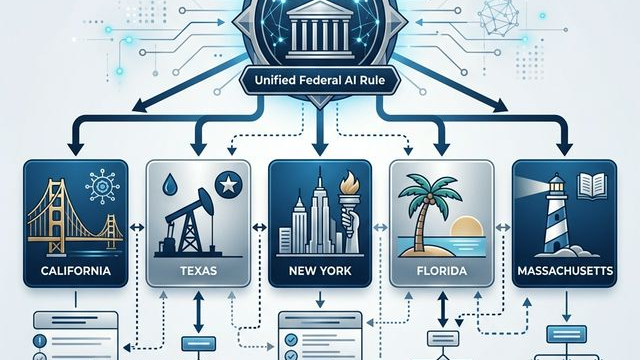

2026年3月21日、ホワイトハウスは連邦議会に向けた新たなAI政策フレームワークを公表した。その骨子は明快だ。「50州がバラバラにAI規制を作るのではなく、連邦レベルで統一的な枠組みを整備せよ」というものである。

このニュースは、単なる米国内の立法動向にとどまらない。グローバルにSaaSやAIツールを活用するBtoB企業、あるいはAIを活用したコンテンツ制作・人材育成・顧客対応を進める企業にとって、提案設計・運用方針・社内ガバナンスの組み方を今すぐ見直すべき理由を突きつける出来事だ。

本記事では、このフレームワークの内容を整理したうえで、SaaS・CS・HR・L&Dの各領域における実務的な示唆を深く考察する。

※画像はNano Banana proで生成。連邦統一ルールと州法の関係性を示す政策構造図(16:9クロップ済み)

※画像はNano Banana proで生成。連邦統一ルールと州法の関係性を示す政策構造図(16:9クロップ済み)

米ホワイトハウスAIフレームワークの全体像

公表の背景:州法乱立がもたらすリスク

2024年以降、米国では各州がそれぞれ独自のAI規制法案を策定・施行する動きが加速していた。カリフォルニア州のSB 1047をはじめ、テキサス、イリノイ、コロラドなど複数の州が異なる基準・罰則・適用範囲を持つAI関連法を次々と提案してきた経緯がある。

この状況が企業にとって深刻な問題をはらんでいたことは想像に難くない。同一のAIサービスを提供しながら、州ごとに異なるコンプライアンス対応を迫られるとなれば、開発コストと法務コストが跳ね上がる。特にスタートアップや中堅SaaS企業にとっては、イノベーションの足かせになりかねない。

こうした背景を受け、ホワイトハウスは「連邦統一ルールによる規制の一本化」という立場を鮮明にした。

フレームワークが定める5つの柱

今回公表されたフレームワークには、以下の主要テーマが含まれている。

- 子どもの保護:未成年者へのAI利用影響を最小化する規定の整備

- エネルギー消費への対応:AIによる高エネルギー消費に関する透明性と効率化の義務付け

- 詐欺・国家安全保障リスクへの対処:ディープフェイクや悪用コンテンツへの規制

- イノベーション促進:過剰規制を避け、技術開発を妨げない枠組みの設計

- AI人材育成:労働市場への影響を緩和するための教育・リスキリング支援

この5本柱は、規制と振興のバランスを意識した設計になっている点が特徴的だ。規制強化一辺倒ではなく、米国としての競争力維持を前提に置いた現実路線といえる。

※出典:Reuters – Trump releases AI policy for Congress to pre-empt state rules

企業のAI導入戦略に何が変わるのか

「便利だから導入する」という提案が通りにくくなる時代

今回のフレームワーク公表が示す最も重要なメッセージは、AIの導入が「機能・便益」の議論から「ガバナンス・説明責任」の議論へと移行しているという事実だ。

これまでのAIツール導入提案では、「業務効率が上がる」「コスト削減につながる」「顧客対応スピードが改善する」といった機能面のアピールが中心だった。しかし、規制フレームワークが整備されていく環境では、導入後の運用体制・データ取り扱い方針・利用範囲の明文化が問われるようになる。

端的に言えば、提案書の中に「ガバナンス設計」のページが1枚ない提案は、今後の意思決定者には刺さりにくくなる。これは半年後・1年後の話ではない。今週出す提案書から意識すべき変化だ。

日本企業が受ける間接的影響

「米国の話であれば日本企業には直接関係ない」と考えるのは早計だ。理由は3つある。

第一に、グローバルSaaSを利用している企業は規制の影響を受ける。米国の連邦法が成立すれば、米国発のSaaSベンダー(Microsoft、Google、Salesforceなど)はその規制に準拠したサービス設計に移行する。利用企業側も利用規約・データ処理条件の変更への対応が発生する。

第二に、日本の規制環境も同様の方向性に向かっている。内閣府・経産省によるAIガバナンスガイドラインはすでに改訂を重ねており、企業のAI利活用に対する説明責任の要求は高まり続けている。

第三に、取引先・資本関係を持つ海外企業からのコンプライアンス要求が強まる可能性がある。特にエンタープライズ向けにSaaSやAIサービスを提供している企業は、取引先から「AIガバナンス方針の開示」を求められるケースが今後増加するとみておくべきだ。

※画像はNano Banana proで生成。規制フレームワークと企業AI導入の関係を示す構造図(16:9クロップ済み)

※画像はNano Banana proで生成。規制フレームワークと企業AI導入の関係を示す構造図(16:9クロップ済み)

SaaS・CS・HR・L&D、各領域別の実務적対応

SaaS:顧客教育と導入支援への組み込み

SaaS企業にとって、今回のフレームワークが示す影響は主に顧客への導入支援設計に現れる。

プロダクト側でどれだけAI機能を強化しても、顧客企業が「どう使うか」「誰が管理するか」「どこまでAIに任せるか」を明確にしていなければ、導入後に問題が生じたとき責任の所在が曖昧になる。これは顧客満足度の低下やチャーンにも直結する。

実務対応として有効なのは、オンボーディングフローの中にAI利用ポリシー策定のステップを設けることだ。たとえば「利用範囲の設定シート」「アウトプットのレビュー責任者の明示」「禁止利用例のリスト」を提供するだけでも、顧客の安心感は大きく変わる。

CS(カスタマーサポート):FAQ・サポート動画の運用設計

CSの現場では、AIを活用したFAQ自動生成・チャットボット・サポート動画の活用が急速に広がっている。しかしこれらのコンテンツは、誤情報が含まれていた場合の影響が直接的で大きいという特性を持つ。

規制フレームワークの文脈では、AIが生成したサポートコンテンツについても、人間によるレビューサイクルや更新責任の明確化が求められる方向にある。

- AIで生成したFAQ・スクリプトには「最終確認者・確認日」を記録するフローを設ける

- サポート動画の内容が制度・仕様変更に追いついているかを定期レビューする仕組みを作る

HR(採用広報):候補者への説明責任が問われる

採用広報においてAIを活用する動きは加速している。AIが生成した求人原稿・採用動画・候補者向け会社紹介コンテンツが一般化しつつある中で、今回のフレームワークが提起する「透明性」と「詐欺的表現の排除」という観点は、HR領域にも直接響く。

特に問題になりやすいのが、AIで生成・強調した社員インタビュー動画や職場環境動画が実態と乖離しているケースだ。規制環境が整備されるにつれ、候補者からの「AIで作ったコンテンツか否か」という問いに対して、企業が誠実に答えられる体制を整えておく必要がある。

L&D(社内研修・教育動画):更新責任と品質保証の仕組み化

研修動画に誤った法律知識・制度情報・業務手順が含まれていた場合、従業員の行動に直接影響を与える。AIが生成した教育コンテンツはこのリスクを増幅させうる。

L&Dにおける対応の要点は、「誰が何を根拠にレビューし、いつ更新するか」をコンテンツ制作フローに組み込むことだ。これはAIガバナンスの観点から求められるだけでなく、研修品質の担保という観点からも本来必要な設計である。

提案書・営業資料への即時反映ポイント

今週から変えられる提案設計の具体例

提案書にAIツールの機能説明と並べて、以下の要素を盛り込んだ「AI利用ポリシー概要シート」を追加することを推奨する。

- 利用範囲の定義(どの業務・プロセスに使うか)

- 出力物のレビュー責任者の明示

- 禁止利用例のリスト

- 更新・管理のサイクル

本事例から得られる示唆と、今後の自社戦略へのネクストステップ

2026年3月のホワイトハウスAIフレームワーク公表は、企業のAI導入を取り巻く環境が「機能競争」から「ガバナンス競争」へと移行していることを端的に示す出来事だ。先行者利益を得るために、以下のネクストステップを推奨する。

- 提案書・営業資料にAIガバナンス設計の概要を追加する

- 既存のAI活用コンテンツに更新責任者と確認サイクルを設定する

- 社内のAI利用ポリシーをドキュメント化し、関係部署と共有する

AI活用の「使いこなし力」だけでなく、「適切に管理・説明できる力」を持つ企業こそが、次の競争ラウンドで選ばれる存在になるだろう。